11 самых эффективных инструментов анализа данных

- Аналитика бизнеса

- Выбор аналитической платформы

- 11 самых эффективных инструментов анализа данных

Оглавление

Представьте, что вы бизнес-аналитик в бренде быстрой моды. Вам поручено понять, почему падают продажи новой линии одежды в данном регионе. Ваша работа состоит в том, чтобы увеличить продажи при достижении желаемого уровня прибыли. Некоторые переменные, которые следует учитывать, – это личность покупателя, отзывы на веб-сайтах, упоминания в социальных сетях, данные о продажах за день и час в разных местах магазина, праздник или другие события, ожидаемые даты выплат в местных компаниях, даже данные тепловой карты для каждого магазина и текущие планограмма.

Это много разных данных, хранящихся в разных форматах. Вы должны извлекать их из различных систем или иногда вручную собирать недостающие данные. Затем, чтобы переместить данные в единое хранилище, исследуйте и визуализируйте их, определяя взаимосвязи между событиями и точками данных. Слишком много измерений, слишком много данных для обработки. Необходима стратегия управления данными и ИТ-инфраструктура для реализации этой стратегии. В этом суть бизнес-аналитики (BI).

Что такое бизнес-аналитика и какие инструменты необходимы для ее поддержки?

Бизнес-аналитика – это процесс доступа, сбора, преобразования и анализа данных для раскрытия информации о деятельности компании. А затем используйте эти знания для поддержки принятия решений.

Да, процесс. Это означает, что бизнес-аналитика включает в себя действия, инструменты и инфраструктуру, которая поддерживает преобразование данных из необработанной формы в удобочитаемые графики. Этот процесс можно рассматривать как цепочку последовательных фаз:

Этап 1. Извлечение данных – подключение к исходным источникам данных и извлечение их из них. Источники данных могут быть внутренними (базы данных, CRM, ERP, CMS, такие инструменты, как Google Analytics или Excel) или внешними (подтверждение заказа от поставщиков, обзоры с сайтов социальных сетей, общедоступные репозитории наборов данных и т. д.).

Этап 2. Преобразование данных – размещение данных во временном хранилище, известном как промежуточная область. Форматирование данных в соответствии с указанными требованиями и стандартами, чтобы сделать их пригодными для анализа.

Этап 3. Загрузка данных – перемещение стандартизированных данных в конечное место хранения – базу данных, озеро данных или хранилище данных. При необходимости создание витрин данных – подмножеств хранилища данных для хранения информации от каждого подразделения компании, например, отдела кадров или отдела продаж.

Этап 4. Визуализация – изучение данных и представление результатов с помощью визуальных элементов (через пользовательский интерфейс).

Шаги 1, 2 и 3 объединены в операции ETL (извлечение, преобразование, загрузка). Процесс ETL определяет, как разнородные данные извлекаются из разрозненных источников, преобразуются в форму, подходящую для анализа, и загружаются в одно место назначения. Мы не будем тратить много времени на объяснение этого здесь, поскольку мы сделали это в специальной статье об ETL-разработчике .

Ранее мы писали о шагах по реализации стратегии бизнес-аналитики , где коснулись инструментов интеграции данных и хранилищ данных. В этой статье мы углубимся в инструменты и сервисы, необходимые для установления и поддержания потока данных от системы к системе с дальнейшим анализом и визуализацией.

Мы рассмотрим два сценария:

Вам нужна вся инфраструктура бизнес-аналитики. Если вы хотите настроить процесс бизнес-аналитики с нуля, подумайте о поставщиках, аналитические решения которых включают модули с ETL, службы хранилищ данных, анализ данных и визуализацию.

Вы стремитесь создать индивидуальную бизнес-аналитику. У вас есть технические специалисты, которые могут разработать индивидуальную платформу бизнес-аналитики или некоторые ее части, но ищут строительные блоки. В этой ситуации мы предлагаем обратить внимание на библиотеки, фреймворки и инструменты, способные выполнять любой из этапов обработки данных.

Поставщики комплексных платформ бизнес-аналитики

Проснувшись однажды утром после беспокойного сна, Грегор Замза обнаружил, что он у себя в постели превратился в страшное насекомое.

Sisense: «для открытия значимых бизнес-идей не требуется докторская степень»

Sisense – это платформа бизнес-аналитики, которая поддерживает все операции бизнес-аналитики, от моделирования и исследования данных до создания информационных панелей. Он поддерживает сценарии локального, облачного и гибридного развертывания.

Источники данных. Существует два способа получения данных с помощью Sisense: импортировать их в ElastiCube, собственную базу данных решения, или напрямую подключаться к источникам. Второй вариант называется живым подключением и хорошо подходит для часто меняющихся данных.

Live Connectors позволяют загружать данные из:

- базы данных (Google BigQuery, Oracle, MySQL, PostgreSQL, SQL Server, MemSQL)

- хранилища данных (Amazon Redshift и Snowflake).

Соединители ElastiCube поддерживают все источники соединителей под напряжением, а также:

- веб-сервисы (Google Analytics / AdWords, Salesforce, MailChimp, Splunk, Stripe, Dropbox и т. д.)

- Источники данных RESTful

- Хранилище данных Hive

- плоские файлы в формате JSON, XML, Excel или CSV.

Соединители с дополнительными официально не поддерживаемыми источниками можно получить в сообществе Sisense. Полный список поддерживаемых источников и типов данных находится в документации.

Преобразование данных. Платформа предоставляет множество функций для преобразования данных. Например, он анализирует, как атрибуты записываются в таблицах, группирует их по сходству, чтобы помочь пользователям согласовать имена атрибутов. Интерфейс упрощает манипуляции с моделями данных.

Визуализация данных. Панели мониторинга создаются в Интернете. Пользователи могут добавлять виджеты на информационные панели. Выбор параметров отчетности обширен: виджет солнечных лучей, тепловая карта календаря, точечная карта, а также линейные, круговые или гистограммы, прямоугольная диаграмма, полярная диаграмма и многое другое.

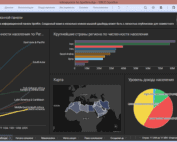

Microsoft Power BI: удобная платформа, работающая на всех устройствах

Microsoft Power BI – это облачное решение для бизнес-аналитики с самообслуживанием для визуального исследования и анализа данных как локально, так и в облаке. Платформа позволяет осуществлять мониторинг данных в реальном времени практически на любом устройстве во всех основных операционных системах, с возможностью включения мобильных предупреждений о любых изменениях.

- базы данных (IBM Netezza, MySQL, Teradata, PostgreSQL и др.)

- хранилища данных (SAP Business Warehouse Server, Snowflake, Google BigQuery, Redshift и т. д.)

- Службы Microsoft Azure

- текстовые / CSV-файлы, а также файлы JSON, PDF, XML, папки и папки SharePoint

- Онлайн-сервисы (объекты / отчеты Salesforce, Google Analytics, Facebook, Zendesk, Stripe, GitHub, Twilio и т. Д.).

Дополнительные источники данных можно найти в документации.

Преобразование данных. Решение включает в себя множество функций преобразования данных. Одна из них называется функцией объединения файлов: пользователи могут объединять все файлы в определенной папке, если они имеют одинаковый тип и структуру файлов, например, одинаковые столбцы. После объединения файлов пользователи могут при необходимости применить дополнительные шаги преобразования или извлечения.

Также существует возможность указывать категории данных для столбцов, чтобы Power BI генерировал для них точные визуализации. Столбцы с такими неоднозначными данными могут содержать географические сокращения: CA как Калифорния и Канада или Джорджия как штат США и страна.

Также доступны стандартные функции, такие как фильтрация строк полей, преобразование текстовых записей в числовые, переименование столбцов или таблиц или установка первой строки в качестве заголовков.

Визуализация данных. Клиенты могут выбирать из множества визуализаций. Инструмент загрузит настраиваемые визуальные эффекты, закрепит визуальные элементы на панели управления как на сайте или изменит их стили, чтобы увидеть, какой из них лучше работает с заданными данными. Вы можете просмотреть список доступных визуализаций здесь. Платформа также имеет встроенные панели мониторинга и отчеты от популярных поставщиков, таких как Salesforce или Google Analytics.

Tableau: анализируйте данные простым перетаскиванием

Tableau, занимающая одно из первых мест в рейтинге Gartner Quadrant, предлагает несколько продуктов для поддержки сквозного аналитического рабочего процесса.

Tableau Server – одно из таких решений. Это платформа корпоративной аналитики, которую можно развернуть локально (Windows или Linux), в общедоступном облаке (AWS, Microsoft Azure или Google Cloud Platform) или полностью разместить у поставщика.

Источники данных. Платформа подключается как к облачным, так и к локальным источникам данных через соединитель веб-данных и API.

Источники данных, поддерживаемые Tableau Server, включают:

- базы данных (Google Cloud SQL, MarkLogic, PostgreSQL и др.)

- хранилища данных (Redshift, Google BigQuery, Cloudera Hadoop, SAP NetWeaver Business Warehouse и т. д.)

- файлы в форматах CSV, PDF, JSON, KML, R, SAS и SPSS.

Преобразование данных. Пользователи могут планировать потоки данных и управлять ими с помощью другого инструмента, Tableau Prep Conductor, который входит в надстройку Data Management, для встраивания информационных панелей в другие приложения и объединения различных наборов данных. Кроме того, решение позволяет пользователям управлять расширениями панели мониторинга – веб-приложениями, которые позволяют пользователям взаимодействовать с данными из других приложений непосредственно в Tableau через API расширений Tableau. Мы упомянули несколько способов управления данными, но их, безусловно, больше.

Визуализация данных. Tableau Server больше всего хвалят за простоту использования, масштабируемость и настраиваемые интерактивные информационные панели.

Например, у него есть функция «Спрашивать данные», которая позволяет пользователям задавать вопросы из любого опубликованного источника данных на естественном языке (посредством набора текста) и получать ответы в виде визуализации. Эта функция основана на алгоритмах «автоматического профилирования, индексации и оптимизации источников данных».

Tableau Server включен в три пакета программного обеспечения: Tableau Creator (70 долларов США), Tableau Explorer (30 долларов США) и Tableau Viewer (12 долларов США). Цена указана за пользователя в месяц при ежегодной оплате. Производитель предлагает бесплатную пробную версию.

Конечно, стоит учитывать и других производителей, получивших самые высокие оценки. Например, Qlik, Looker, ThoughtSpot, такие продукты, как SAS Business Analytics, Salesforce Einstein Analytics или решения SAP для бизнес-аналитики. Чтобы узнать больше об инструментах Tableau BI, ознакомьтесь с нашей связанной статьей.

Далее мы рассмотрим второй сценарий – создание пользовательской бизнес-аналитики с использованием специализированных инструментов. Начнем с интеграции данных.

Инструменты и библиотеки / пакеты ETL

Informatica PowerCenter: платформа интеграции данных на основе метаданных

PowerCenter – это платформа интеграции корпоративных данных от Informatica – поставщика решений для управления данными, качества, безопасности и интеграции. Уровень сервиса метаданных, который обеспечивает лучшее качество и согласованность данных, является одной из особенностей платформы. Например, с возможностью проверки происхождения данных аналитики могут «отслеживать, какие данные были изменены, когда и кем, чтобы поддержать бизнес и нормативные требования к проверке и аудиту данных». Метаданными можно обмениваться с разными приложениями.

Платформа поддерживает пакетную обработку данных и обработку данных в реальном времени. Он подключается как к локальным, так и к облачным источникам данных через REST API.

Инструмент поддерживает множество источников данных:

- базы данных (IBM DB2 UDB, Oracle, Microsoft SQL Server, Microsoft Azure SQL Database, Netezza)

- файлы в форматах PDF, XML, JSON, Microsoft Office

- Данные об устройствах Интернета вещей.

Рецензенты Capterra и Gartner Peer Insights отмечают простоту использования этого инструмента даже для людей без опыта разработки программного обеспечения.

PowerCenter доступен в облаке, как SaaS и веб-сервис. Цены доступны по запросу. По словам одного из обозревателей, цены на лицензии достаточно дороги , но приемлемы.

Talend Data Fabric: набор решений для интеграции данных со многими поддерживаемыми источниками и форматами данных

Talend – поставщик решений для интеграции и обеспечения целостности данных – еще один лидер в «Магическом квадранте» Gartner. У компании есть Talend Data Fabric, набор приложений для сбора, управления, преобразования и обмена данными в облачных или локальных системах. Можно приобрести весь пакет или выбрать интересующие товары. Кратко опишем возможности двух из них.

Stitch Data Loader – это облачная служба ETL, которая извлекает данные из различных источников через API импорта и реплицирует их (не в реальном времени) в конечный пункт назначения.

Источники, из которых вы можете извлечь данные, включают:

- базы данных (MySQL, MongoDB, Amazon Oracle RDS и т. д.)

- хранилища данных и озера данных (Amazon Redshift, Snowflake, Amazon S3, PostgreSQL, Azure SQL Data Warehouse, Google BigQuery, Panoply и т. д.)

- Приложения и сервисы SaaS (Zendesk, Salesforce, Stripe, Google Ads, Facebook Ads и т. Д.).

Зарегистрированные пользователи могут выбирать между бесплатными и стандартными планами.

Talend Open Studio – это служба интеграции данных, выпущенная под лицензией Apache с открытым исходным кодом. Он сочетает в себе графическую среду проектирования с подходом, основанным на метаданных. Пользователи могут экспортировать и выполнять автономные задания в среде выполнения.

Open Studio подключается к:

- реляционные базы данных (Oracle, Microsoft SQL server, Teradata и др.)

- хранилища данных (Snowflake, Azure SQL Data Warehouse, SAP Business Warehouse и т. д.)

- Приложения SaaS (NetSuite, Marketo, Salesforce и т. Д.)

- приложения и сервисы (SAP, Microsoft Dynamics, Sugar CRM, Dropbox и др.)

- текстовые файлы, Интернет вещей и машинные данные.

Все разъемы для продуктов Talend опубликованы здесь.

Решение также поддерживает протоколы SMTP, FTP / SFTP, LDAP. Помимо REST, он поддерживает интеграцию SOAP API.

Apache Spark: создание конвейера ETL на Python, Scala, Java, SQL и R

Apache Spark, аналитический движок для крупномасштабной обработки данных, можно использовать для построения конвейера ETL для приложений на Python (с PySpark API), Java, SQL, Scala и R (с пакетом SparkR). Spark позволяет обрабатывать потоковые данные параллельно (несколькими процессорами или компьютерами одновременно), вот что такое высокая масштабируемость, скорость обработки больших объемов данных. Вы можете работать с неструктурированными, полуструктурированными и структурированными данными во множестве форматов, включая JSON, CSV, TXT, Parquet, Avro, ORC. Стоит отметить, что создание конвейеров ETL с помощью Spark требует навыков программирования.

Пакеты для ETL содержат функции, фрагменты кода, которые возвращают значение – переменную или другую информацию, возвращаемую из любой подпрограммы. Их много на выбор.

Petl: универсальный пакет Python для ETL

Petl – это универсальный пакет для извлечения, преобразования и загрузки таблиц данных в Python. Пакет предоставляет средства для извлечения текстовых XML, HTML, JSON, CSV и многих других типов файлов, построения таблиц и загрузки их в выбранную систему хранения.

Разработчики petl отмечают, что пакет хорошо подходит для работы с разнородными данными и / или данными смешанного качества. По словам разработчиков, конвейеры преобразования petl минимально используют системную память и могут масштабироваться до миллионов строк, если скорость не является приоритетом.

Перечисление всех инструментов для построения конвейеров ETL выходит за рамки этой статьи. Однако давайте вспомним еще о некоторых из них: Apache Kafka, Apache Samza, Apache Storm, Pentaho Data Integration и Amazon Kinesis Firehose.

Теперь давайте поговорим о решениях для хранения, которые сохранят ваши преобразованные данные в безопасности и будут готовы к запросам. Вот несколько популярных вариантов.

Oracle Autonomous Data Warehouse: полностью автономная база данных с эластичным масштабированием

Oracle Autonomous Data Warehouse – это полностью автономная облачная система хранения, построенная на вычислительной платформе Oracle Exadata. Согласно официальному сайту, он имеет три основных характеристики: автономное вождение, самообеспечение и самовосстановление. Автономность означает, что DW не требует ручной настройки администраторами баз данных – для этого используется машинное обучение. Самозащита достигается за счет автоматического резервного копирования данных и обновлений безопасности, а также мониторинга доступа. Третья особенность – автоматическое восстановление после простоя.

DW может загружать файлы из облачных служб хранения данных (Azure Blob Storage, Amazon S3, Oracle Object Store) или локальных источников данных. Масштабируется эластично. Объем загружаемых данных можно масштабировать.

Инструмент совместим с:

- Инструменты Oracle BI (Data Visualization Desktop, Oracle Analytics Cloud) и облачные сервисы (Oracle Analytics Cloud, Oracle Integration Cloud Service и т. Д.)

- сторонние инструменты бизнес-аналитики, интеграции данных и визуализации.

Он также поддерживает подключение через SQL * Net, JDBC и ODBC.

Чтобы начать использовать эту службу хранилища данных, зарегистрируйте учетную запись Oracle Cloud и выберите подписку с оплатой по мере использования (2,5202 долл. США в час) или ежемесячный гибкий план (1,680133 долл. США в час). Вы можете использовать оценщик затрат.

Snowflake: облачное хранилище данных SQL для хранения и анализа разнообразных данных, не требующих никакого управления

Snowflake – это облачное хранилище данных SQL, предоставляемое как SaaS. Подобно складу от Oracle, он исключает ручное администрирование и управление. Поставщик занимается обслуживанием, управлением и настройкой хранилища.

Для клиентов доступны пакетные данные (провайдер называет это массовыми) и загрузка данных в реальном времени (непрерывная). Последнее осуществляется с помощью службы непрерывного приема данных Snowpipe. DW автоматически масштабируется вверх и вниз на ходу.

Пользователи хранилища могут работать с данными из:

- внутренние (например, снежинки) этапы

- сервисы облачного хранения данных (Google Cloud Storage, Amazon S3 и хранилище BLOB-объектов Microsoft Azure)

- облачные платформы (Amazon Web Services, Microsoft Azure).

Snowflake можно использовать для работы как со структурированными (CSV и таблица), так и с полуструктурированными данными (JSON, Avro, Parquet или XML).

Поскольку Snowflake совместим с облачными платформами AWS и Microsoft Azure, ее архитектурные уровни (хранилище, вычисления и службы) полностью развернуты и управляются на выбранной платформе.

Можно подключиться к Snowflake и управлять им через веб-интерфейс пользователя, клиентов командной строки (например, SnowSQL), собственные соединители (например, Python), которые можно использовать для разработки приложений для подключения к этому хранилищу данных. Существуют сторонние соединители для подключения таких приложений, как инструменты ETL (например, Informatica) и инструменты бизнес-аналитики, к Snowflake. Также доступно соединение ODBC и JDBC, поэтому вы можете подключать другие приложения, такие как Tableau, со Snowflake.

Snowflake предлагает несколько вариантов цен.

Ценообразование, основанное на использовании, доступно в рамках плана Snowflake on Demand. Другие способы – выбрать предварительно приобретенные варианты емкости Snowflake или получить цены в зависимости от региона, используемой облачной платформы (AWS или Microsoft Azure) и количества возможностей.

Amazon Redshift: быстрое масштабируемое хранилище данных в облаке

Amazon Redshift – это облачная, полностью управляемая служба хранилища данных корпоративного уровня, которая может масштабироваться с нескольких сотен гигабайт до петабайта и более. «Сервис» означает, что он используется для создания хранилищ данных и управления ими.

Это хранилище данных представляет собой набор вычислительных ресурсов – узлов, сгруппированных в кластер. В кластерах с двумя или более узлами дополнительный ведущий узел координирует вычислительные узлы и обрабатывает внешнюю связь.

Пользовательские данные хранятся на узлах. В каждом кластере работает механизм Amazon Redshift и одна или несколько баз данных. Кластерами можно управлять с помощью API управления Amazon Redshift, пакетов SDK AWS и интерфейса командной строки AWS (AWS CLI).

Служба хранилища основана на системе управления реляционными базами данных PostgreSQL (СУБД), что делает ее совместимой с другими приложениями СУБД. Кроме того, он интегрируется с различными инструментами загрузки данных и ETL, средствами отчетности, аналитики и интеллектуального анализа данных. Полный список партнеров Amazon опубликовал здесь.

Сервис поддерживает загрузку данных для файлов в форматах AVRO, JSON, CSV, Parquet, ORC и TXT.

Чтобы запросить DW (из клиентских приложений), необходимо использовать Консоль управления AWS с редактором запросов или клиентские инструменты SQL, поддерживающие JDBC и ODBC.

Redshift автоматически и периодически выполняет резервное копирование данных в Amazon S3.

Для начала использования Amazon Redshift требуется учетная запись AWS. У пользователей есть четыре варианта ценообразования на выбор. Цена по запросу – это почасовая оплата (от 0,25 доллара США) в зависимости от типа и количества узлов; Стоимость Amazon Redshift Spectrum зависит от количества просканированных байтов.

Масштабирование параллелизма влечет за собой получение от одного до трех бесплатных кредитов в день и посекундную оплату услуги по запросу. Зарезервированный инстанс – это цена со скидкой для тех, кто использует Redshift в течение одного или трех лет. Доступна бесплатная двухмесячная пробная версия.

Также рассмотрите SAP BW / 4HANA (локальное и облачное развертывание), IBM Db2, BigQuery от Google, Teradata Integrated Data Warehouses , Microsoft Azure.

Инструменты и библиотеки визуализации данных

D3: независимая от фреймворка библиотека JavaScript для создания оригинальных визуализаций

D3 – это библиотека JavaScript с открытым исходным кодом для визуализации данных с использованием веб-стандартов – HTML, SVG и CSS. Он поддерживает любой интерфейсный фреймворк, будь то Vue.js, React, Polymer, Angular или другие.

С помощью D3 разработчики могут привязать произвольные данные к объектной модели документа (DOM) и управлять документом на основе данных. Модель DOM – это стандарт для доступа к изменяющемуся содержимому и обновления содержимого, структуры и стиля HTML-документа. На веб-сайте D3 говорится: «Например, вы можете использовать D3 для создания таблицы HTML из массива чисел. Или используйте те же данные для создания интерактивной гистограммы SVG с плавными переходами и взаимодействием».

D3 – хороший инструмент, когда вы хотите представить данные с помощью динамических визуальных элементов и разработать их уникальным способом, чтобы выделиться из толпы. На это намекает даже интерактивная визуализация на главной странице сайта D3 с примерами с разных порталов.

Давайте посмотрим на инфографику о положении дел в общинах коренных народов Аляски, подготовленную The Guardian, в качестве примера того, что вы можете сделать с D3. Внешний вид меняется, когда пользователь перемещается по регионам на карте и нажимает кнопки «Население», «Коренные жители Аляски» и «Доход» в левой части экрана.

Chart.js: крошечная библиотека с множеством адаптивных диаграмм и вариантов интеграции.

Chart.js – это библиотека с открытым исходным кодом (распространяется под лицензией MIT) с полностью адаптивными диаграммами.

Библиотека предоставляет множество примеров для изучения и иллюстрации точек данных различными способами. Например, статические и динамические столбчатые, линейные, площади, радарные, пузырьковые, точечные, кольцевые или круговые диаграммы (да, мы специально разместили их вместе). Коллекция также включает полярную область, шкалы временных рядов, комбинированные шкалы для просмотра двух или более наборов данных, индикаторы выполнения и многое другое. Внешний вид и поведение диаграмм можно изменить с помощью плагинов.

Например, интерактивная пузырьковая диаграмма визуально реагирует, когда пользователь добавляет, удаляет наборы данных или рандомизирует точки данных:

MetricsGraphics: библиотека JavaScript со стандартными визуальными элементами для данных временных рядов.

MetricsGraphics – это библиотека на основе D3 для визуализации данных временных рядов. Пользователи могут выбирать из интерактивной графики, такой как диаграммы рассеяния, линейные диаграммы, гистограммы, таблицы данных, гистограммы, а также графики коврика или базовую линейную регрессию. Хотя количество визуальных элементов невелико, у каждого из них есть множество вариаций.

Создатели библиотеки отмечают, что MetricsGraphics не зависит от источника данных: «Хотя он предоставляет ряд удобных функций и опций, которые позволяют графике лучше обрабатывать такие вещи, как отсутствующие наблюдения, ему все равно, откуда берутся данные ». Другие характеристики, на которые указывают его разработчики, – это простой API и способность легко создавать повествования, предоставляя шаблон макета на основе Bootstrap.

Другие библиотеки, на которые стоит обратить внимание, – это Recharts (React), React-Vis от Uber, VX (React + D3), three.js, Raphael для векторной графики и другие. Выбор может зависеть от типа данных, которые вы используете чаще всего, от опыта внешних разработчиков или личных предпочтений.

Как правильно выбрать инструмент бизнес-аналитики?

Возвращаясь к двум сценариям… Если вы находитесь в начальной точке на пути к полной инфраструктуре бизнес-аналитики и у вас нет команды разработчиков, изучите комплексные решения. Контрольный список для оценки может включать:

Поддерживаемые сценарии развертывания. Исходя из ваших требований к безопасности данных, бюджета и возможной потребности в масштабировании, определите, какой тип развертывания вам нужен, и проверьте, поддерживает ли это решение. Если вы не уверены в этом, поищите консультанта.

Масштабируемость. Легко ли увеличить объем хранилища, вычислительную нагрузку и количество пользователей? Большинство поставщиков выделяют эту возможность в описании продукта. Вы всегда можете связаться с продавцом для получения более подробной информации.

Удобство использования. От четкой и хорошо структурированной документации и опубликованных видеоуроков до интуитивно понятного интерфейса с функцией перетаскивания для управления данными – хороший инструмент должен иметь все это.

Количество и типы поддерживаемых источников данных. Выясните, позволяет ли инструмент получать данные в пакетном режиме, в режиме реального времени или почти в реальном времени. Какие варианты подключения (API и / или веб-коннекторы) включены?

Преобразование данных. Решения всегда включают базовые функции для преобразования данных. Уникальные функции могут иметь значение для вас.

Визуализация. Возможно, вы захотите посмотреть количество и типы поддерживаемых визуальных элементов, возможность их настройки и встраивания информационных панелей в другие приложения. Если вы имеете дело с потоковой передачей данных, узнайте, поддерживает ли платформа визуализацию данных в реальном времени.

Варианты и сроки ценообразования. Оцените тарифные планы и их условия (фиксированные, с оплатой по мере использования или со скидкой). Есть ли пробная версия для тестирования инструмента?

Служба поддержки. Посмотрите, какие каналы (электронная почта, звонок и т. Д.) Вы можете использовать для связи со специалистами службы поддержки, их график работы. Веб-сайт обзора обычно включает вопросы о качестве обслуживания и поддержки.

Если вы планируете создать собственный инструмент бизнес-аналитики или некоторые его модули с использованием компонентов с открытым исходным кодом, проверьте, насколько велико их сообщество, сколько у них запускается GitHub, помимо рассмотрения требований к комплексным решениям, о которых мы упоминали выше, конечно

Почитать еще

10 инструментов аналитики данных

Загрузить программу ВІ Демонстрации решений Аналитика бизнеса Оглавление Введение в аналитику данных Прогресс в любой

Экосистема JavaScript: 38 инструментов для фронтальной и серверной разработки

В течение шести лет JavaScript оставался самым популярным языком интерфейсного программирования. Достаточно взглянуть на результаты

Инструменты интеграции данных

Инструменты интеграции данных предназначены для широкого спектра сценариев использования, которые зависят от основных возможностей доставки

TIBCO Spotfire 11.0

Spotfire 11.0 представляет Spotfire Mods — легкий облачный фреймворк для создания новых интерактивных типов визуализаций, позволяющий создавать

50 новых инструментов для анализа и визуализации данных

Подобно тому как ранее мы стали свидетелями перехода на платформы сбора данных, работающие по принципу

Обновления TIBCO Spotfire 7.5-10.2

Загрузить программу ВІ Демонстрации решений Версия 10.2 Поддержка SAP HANA 2 Коннектор SAP HANA теперь

Обновления TIBCO Spotfire Версия 10.7

Версия 10.7 Теперь Spotfire Analyst поддерживает использование языка Python прямо «из коробки». Это означает, что

Обновления TIBCO Spotfire Версия 10.9

Версия 10.9 Основные новые функции и изменения в версии Загрузить программу ВІ Демонстрации решений Аналитика

Обновление Tibcо Spotfire 10.10

Spotfire 10.10 LTS является релизом с долгосрочной поддержкой (Spotfire Long-Term Support release), а также представляет

Несколько видео о наших продуктах